엔비디아가 출력 속도가 기존 모델 H100 두 배인 최신 AI가속기 H200을 11월 13일 공개했다. H200에는 5세대 HBM을 뜻하는 최신 'HBM3 E'가 적용된다고 한다. AI가속기에 없어서는 안 될 HBM은 어떻게 등장하게 되었을까?

◆HBM 등장 배경

Chat GPT 출시→ AI가속기(칩) 등장→ GDDR(D램)이 등장→ HBM의 등장

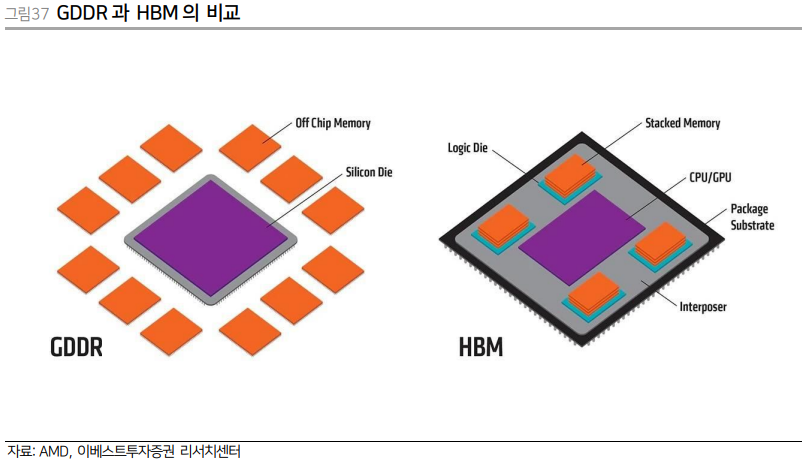

2022년 11월 30일 출시한 Chat GPT로 반도체 시장의 판도가 바뀌었다. Chat GPT는 AI서버 시장의 폭발적인 성장을 가져왔다. 컴퓨터 주연산장치인 CPU만으로는 방대한 인공지능 언어 처리에 무리가 생기면서 인공지능만을 위한 독자적인 하드웨어인 AI가속기(AI칩)가 필요해졌다. 시간이 지나면서 AI가속기 사용에도 불구하고 처리해야 하는 데이터의 양이 한계를 넘어서면서 GPU의 속도를 향상하는 GDDR(GPU용 D램)이 등장했다. 하지만 GDDR(D램)은 용량이 적고 데이터가 오고 가는 출입 통로가 32개뿐이어서 데이터 병목 현상이 발생했다. 이에 따라 대규모 데이터 처리가 가능한 고성능 메모리의 필요성이 증대되었고 그래서 등장한 것이 바로 고대역폭 초고속 메모리 반도체 HBM(High-Bandwidth Memory)이다.

그렇다면, 글로벌 메모리 기업인 SK하이닉스, 삼성전자, 마이크론 기업별로 HBM이 어디까지 성장했는지 세계 점유율과 함께 알아보자.

▣글로벌 메모리 반도체 기업

1. SK하이닉스

현 HBM시장 점유율 50%

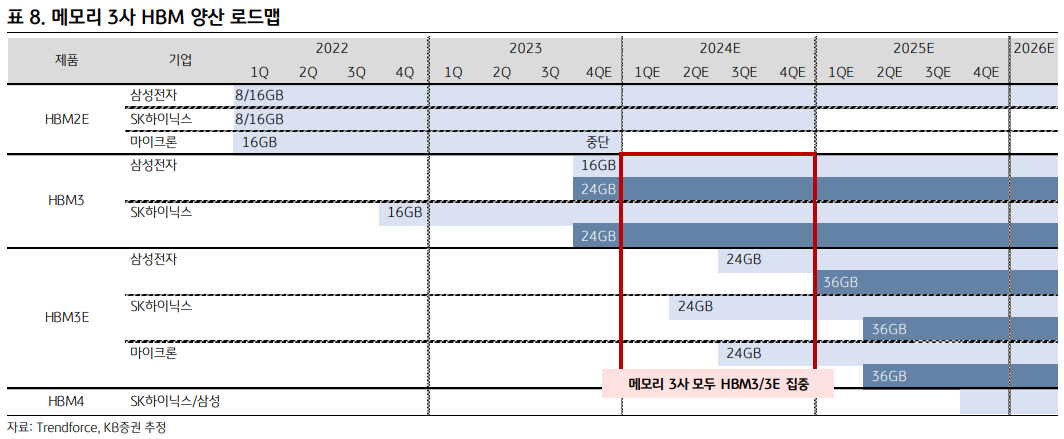

-2021년 HBM3를 세계 최초로 개발한 뒤 올해 4월 24GB HBM3 신제품 출시 예정임.

-4세대(HBM3) 시장 주도 중임.

-올해 2023년 8월부터 고객사 엔비디아에 'HBM3 E' 샘플을 공급하기 시작했으며 내년 양산에 돌입할 계획임.

-HBM3 E: 초당 최대 1.15 테라바이트(TB) 이상의 데이터를 처리함.

-HBM3와 HBM3E의 2024년 캐파가 완판 됨.

-HBM 제조 과정에 활용되는 TSV(실리콘 관통 전극) 공정에 투자를 확대하겠다고 밝힘.

2. 삼성전자

현 HBM시장 점유율 40%

-올해 4분기부터 고객사 확대를 통해 HBM3의 판매를 본격화할 계획임.

-10월 20일 HBM3 E D램 '샤인볼트'를 선보임.(1.5배 수준으로 초당 최대 1.2TB 이상의 데이터를 처리함.)

-TSV 공정 없이 제작할 수 있는 업계 최초 12 나노급 32Gb DDR5D램을 개발함.

-HBM3 E의 경우 샘플 공급을 시작해 내년 하반기 양산 시작할 예정임.

-내년 6세대(HBM4) 양산 준비 중임.

3. 미국 마이크론

HBM시장 후발주자 점유율 10%

-내년 1분기부터 24GB HBM3E 생산 시작할 계획임.

-지난 7월 5세대 급 HBM3 젠 2를 개발함.(1.2TB 이상 대역폭과 9.2기가 바이트(GB) 이상 핀 속도임.)

▷현재 HBM시장 주도 기업은 SK하이닉스!

메모리 3사 모두가 HBM투자를 확대하고 있다. 엔비디아와 AMD 등 빅테크 기업들의 자체 칩 개발로 HBM의 수요는 증가할 전망이다. HBM 가격은 초프리미엄 수준으로 HBM 매출 비중이 올라가면서 하이닉스의 D램 매출 안에서 HBM 비중은 3 Q22 한 자릿수에서 2Q23에는 20%를 돌파했다. 아래의 자료를 보면 현재는 엔비디아에 HBM3E를 독점 공급하는 선진입한 SK하이닉스 중심의 HBM 시장임을 알 수 있다.

▷삼성전자- 세계 최초로 HBM-PIM(Processing-in-Memory)을 개발.

삼성전자가 세계 최초로 메모리 반도체와 인공지능 프로세서를 하나로 결합한 HBM-PIM(Processing-in-Memory)을 개발했다. PIM(Processing-in-Memory)은 메모리 내부에 연산 작업에 필요한 프로세서 기능을 더한 차세대 신개념 융합기술이다. 그만큼 프로세서와 메모리 간의 데이터 이동이 줄어들어 AI 가속기 시스템의 성능과 에너지 효율을 높일 수 있다. 이처럼 삼성전자는 HBM에 메모리에서도 연산처리 기능을 할 수 있도록 PIM을 세계 최초로 적용해 HBM 시장에서 차별화를 시도하고 있다. AMD의 그래픽처리장치(GPU) 'MI-100' 가속기 카드에 삼성전자의 HBM-PIM 메모리를 탑재하기도 했다. PIM 기술을 활용하면 에너지 소모, 즉 전력이 50% 이상 감소한 것을 확인했다.

▷삼성전자와 SK하이닉스 전망

최근 AMD는 인스팅트 MI300 시리즈를 출시했다. 엔비디아 H100과 유사한 MI300X는 마이크로소프트와 오픈 AI, 오라클, 델, 시스코 등 10개 사가 채택할 예정이라고 하는데 새로운 AI가속기를 출시할수록 HBM을 생산하는 SK하이닉스와 삼성전자가 수혜를 볼 것으로 예상된다. 증권가에서는 공장 증설을 통해 SK하이닉스의 생산능력이 증가하더라도 수요에 비해 공급이 부족한 상황이라 삼성전자의 HBM반도체를 사용하게 되면서 삼성전자의 점유율이 SK하이닉스와 비슷해질 것이라고 전망하고 있다.

이 포스팅에서는 고성장하는 AI가속기 칩 분업구조와 세계 메모리 반도체 기업의 현 HBM 위치와 미래를 알아보았다. 앞으로의 AI와 챗GPT, 그리고 HBM반도체가 어떻게 성장해 갈지, 우리나라 반도체 기업들의 미래가 기대된다.

'경제' 카테고리의 다른 글

| 로봇 시장의 현재와 미래 전망 (22) | 2023.12.17 |

|---|---|

| 대기업의 로봇 산업 투자, 로봇 관련주 14곳 정리 (9) | 2023.12.15 |

| 자율주행차의 핵심, 차량용 반도체 관련주 및 대장주 정리 (6) | 2023.12.11 |

| 경쟁력 있는 국내 후공정 OSAT 관련주 TOP5 업체 소개 (28) | 2023.12.07 |

| 후공정의 변화 첨단 어드밴스드 패키징 2.5D 3D 패키징 (11) | 2023.11.30 |